Quand Google a lancé Gemma 4 dans sa version contenant 26 milliards de paramètres, la première impression de la plupart des utilisateurs était :

"C'est incroyable, mais mon ordinateur ne pourra jamais le faire tourner !"

Logiquement, les modèles de cette taille nécessitent de la RAM et des cartes graphiques à des prix astronomiques. Mais Gemma 4 26B est différent de tous les modèles précédents — car derrière lui se cachent deux secrets qui ont rendu son exécution possible sur des ordinateurs ordinaires.

Dans cet article, nous allons vous révéler ces deux secrets, et vous guider à travers des étapes simples pour installer le modèle et le tester vous-même.

Le Premier Secret : Mixture of Experts — Le Génie Architectural

Avant de parler de compression, vous devez comprendre ce qui rend Gemma 4 26B fondamentalement différent de tout autre modèle 26B.

Gemma 4 26B n'est pas un modèle traditionnel — c'est un modèle Mixture of Experts (MoE), ce qui signifie simplement :

Imaginez que vous avez une équipe de 26 experts spécialisés. Quand vous posez une question, toute l'équipe ne vous répond pas — le système sélectionne automatiquement les 3-4 experts les plus intelligents adaptés à votre question, et ignore les autres.

C'est exactement ce que fait Gemma 4 26B :

- Total des paramètres : 26 milliards — stockés en mémoire

- Paramètres actifs par réponse : seulement 3,8 milliards

- Résultat : vitesse d'un petit modèle + intelligence d'un grand modèle

Cela seul réduit considérablement les besoins en calcul. Mais le problème restant est la taille de stockage et la mémoire — et c'est là qu'intervient le deuxième secret.

Le Deuxième Secret : La Technologie de Quantification 4-bit

Même avec MoE, stocker 26 milliards de paramètres nécessite encore un espace énorme. C'est là qu'intervient la technologie de compression (Quantization).

Pour simplifier : imaginez une image en haute résolution 4K — elle est volumineuse et nécessite un écran avancé. Si vous la compressez en 1080p, sa taille diminue considérablement, mais les détails essentiels restent clairs pour le spectateur ordinaire.

C'est ce que fait la technologie Quantization :

- Le modèle original au format 16-bit = très volumineux

- Après compression en 4-bit = la taille réduit de 75%

- Sauvegardé au format GGUF, adapté au déploiement local

La Magie Se Produit Quand les Deux Secrets Se Combinent

Gemma 4 26B sans aucune compression (16-bit) — Mémoire requise : ~52 Go Avec MoE uniquement (8-bit) — Mémoire requise : ~28 Go Avec MoE + compression 4-bit — Mémoire requise : seulement 18 Go ✅

De 52 Go à 18 Go — sans perte notable d'intelligence.

Est-ce que Gemma 4 Perd Son Intelligence Après la Compression ?

C'est la question la plus importante. Les expériences terrain de la communauté r/LocalLLaMA et des laboratoires Unsloth ont prouvé :

La perte d'intelligence après compression en 4-bit ne dépasse pas 5% — ce qui est pratiquement imperceptible pour l'utilisateur ordinaire.

Le modèle après compression est toujours capable de :

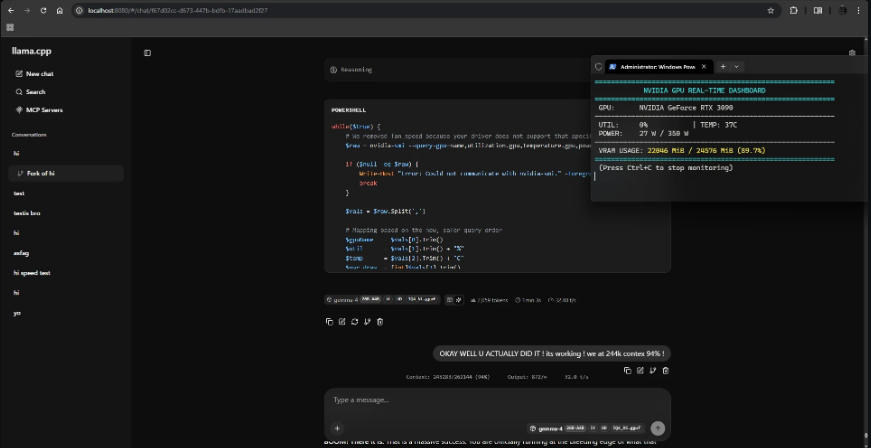

- Raisonnement logique complexe — résout des énigmes et comprend un long contexte jusqu'à 256K tokens

- Programmation avancée — écrit et débogue du code avec une grande efficacité

- Compréhension multilingue — supporte plus de 140 langues dont l'arabe

- Analyse d'images — comprend et analyse le contenu visuel

Gemma 4 26B a atteint la 6ème place mondiale dans le classement LMArena des modèles open source — surpassant des modèles 20 fois plus grands en taille.

Comparaison Rapide : Quelle Version Choisir ?

Gemma 4 E4B : Mémoire requise : 8 Go+ Vitesse de réponse : Très rapide Intelligence et raisonnement : Excellent pour les tâches de base Support images et audio : Oui Utilisation recommandée : Ordinateurs économiques et téléphones

Gemma 4 26B (4-bit) : Mémoire requise : 24 Go+ Vitesse de réponse : Bonne (dépend du processeur) Intelligence et raisonnement : Performance avancée en programmation et analyse complexe Support images et audio : Images uniquement Utilisation recommandée : Ordinateurs milieu et haut de gamme

Configuration Requise Précise pour Gemma 4 26B

Configuration minimale pour fonctionner :

- RAM : Au moins 18 Go (pour la version 4-bit)

- Stockage : 20 Go ou plus

- Système d'exploitation : Windows, Mac ou Linux

Pour les meilleures performances :

- GPU avec 24 Go de VRAM (comme RTX 4090 ou RTX 3090)

- Ou Mac M1/M2/M3 avec 24 Go+ de mémoire unifiée

Note importante : Si votre appareil dispose de moins de 18 Go — utilisez Gemma 4 E4B qui fonctionne avec seulement 8 Go et est excellente pour les tâches quotidiennes.

Guide d'Installation Complet

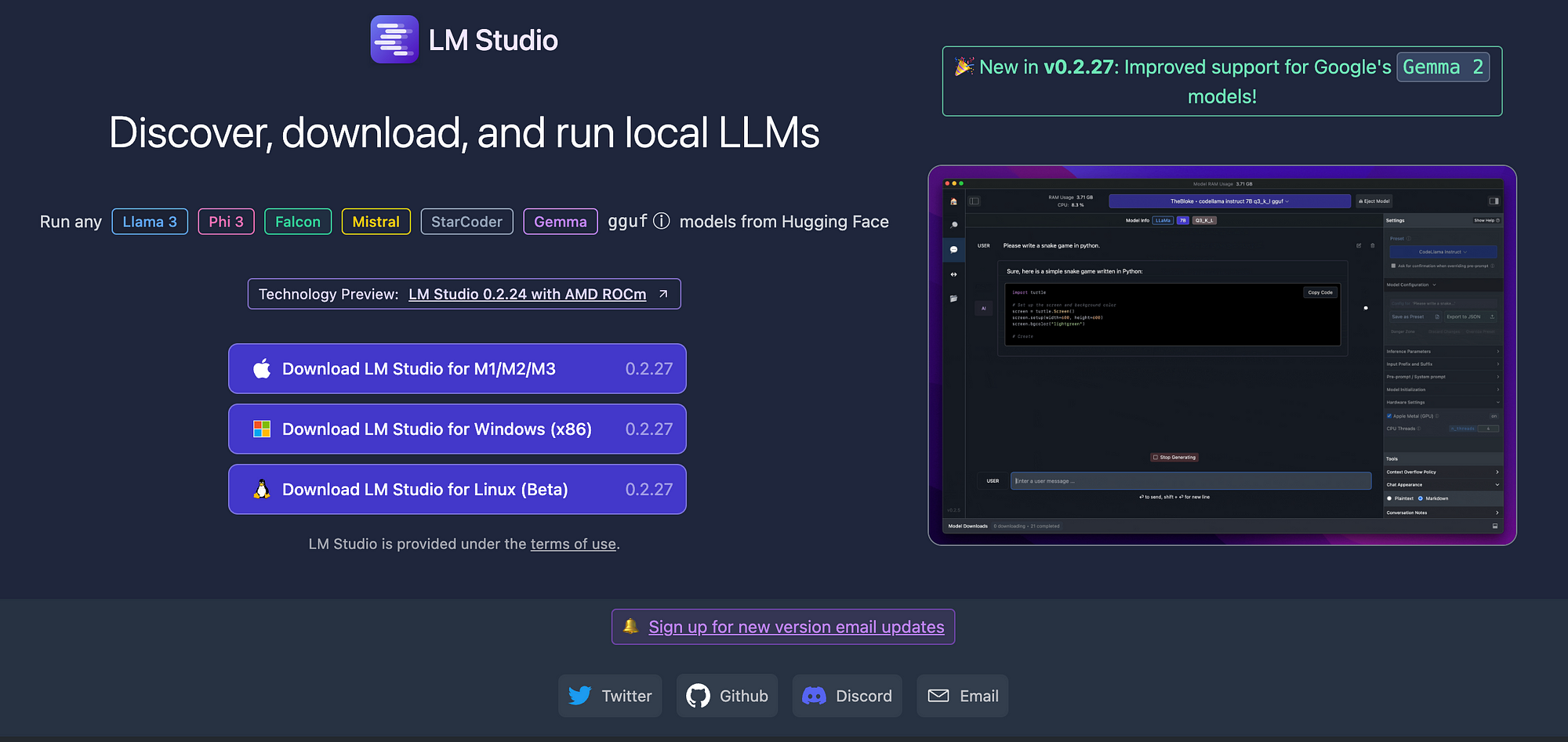

Méthode Une : LM Studio (Pour Débutants — Interface Graphique)

1. Téléchargez et installez LM Studio gratuitement

2. Ouvrez le programme et allez dans l'onglet recherche — tapez :

Gemma-4-26B GGUF

3. Choisissez la version se terminant par Q4_K_M — c'est la meilleure en termes d'équilibre entre taille et qualité

4. Cliquez sur Download et attendez la fin du téléchargement

5. Sélectionnez le modèle dans la liste de chat et commencez la conversation directement

Méthode Deux : Ollama

1. Téléchargez et installez Ollama gratuitement

2. Ouvrez le Terminal ou l'invite de commande et tapez :

ollama run gemma4:26b

3. Attendez la fin du téléchargement — puis commencez la conversation directement dans le terminal

Pour relancer les prochaines fois sans re-télécharger :

ollama run gemma4:26b

Conclusion

Gemma 4 26B représente une véritable avancée dans le monde des modèles open source — pas seulement parce qu'il a été compressé, mais parce qu'il est conçu dès le départ pour être efficace sur les appareils personnels grâce à l'incroyable architecture MoE. Il a transformé un modèle nécessitant 52 Go en un modèle fonctionnant sur 18 Go — tout en préservant 95% de son intelligence d'origine.

Si votre appareil dispose de 18 Go de RAM ou plus — Gemma 4 26B est le meilleur modèle open source que vous puissiez exécuter localement aujourd'hui.

Vous voulez vous assurer que le modèle fonctionnera sur votre appareil avant de le télécharger ? → Comment s'assurer qu'un modèle LLM fonctionnera sur votre appareil avant de le télécharger

Vous voulez savoir comment télécharger n'importe quel projet GitHub en un clic sans Terminal ni Git 2026 ? → Télécharger n'importe quel projet GitHub en un clic