Introduction

De nombreux utilisateurs souhaitent désormais essayer d’exécuter des modèles de langage large (LLM) localement — comme Llama, Gemma, Mistral ou Qwen — mais ils rencontrent toujours le même problème courant :

« Est-ce que ce modèle fonctionnera vraiment sur mon appareil ? »

« Est-ce que ma RAM est suffisante ? »

« Est-ce que ma carte graphique pourra le supporter ? »

Souvent, ils téléchargent le modèle (parfois plusieurs gigaoctets), puis découvrent après plusieurs heures qu’il ne fonctionne pas ou qu’il est extrêmement lent… ce qui fait perdre du temps et des efforts inutilement.

La solution simple et intelligente à ce problème est l’outil llmfit.

Dans cet article, je vais vous expliquer rapidement :

- Ce qu’est llmfit et comment il fonctionne

- Quelles sont les fonctionnalités qu’il propose

- Pourquoi il est très utile pour les développeurs et les passionnés qui exécutent des modèles localement

Qu’est-ce que llmfit ?

llmfit est un outil open source spécialement conçu pour vous aider à vérifier la compatibilité des modèles d’IA LLM avec votre appareil avant de les télécharger.

Au lieu de deviner ou de procéder par essais et erreurs, llmfit analyse intelligemment votre appareil et vous fournit un rapport clair et direct.

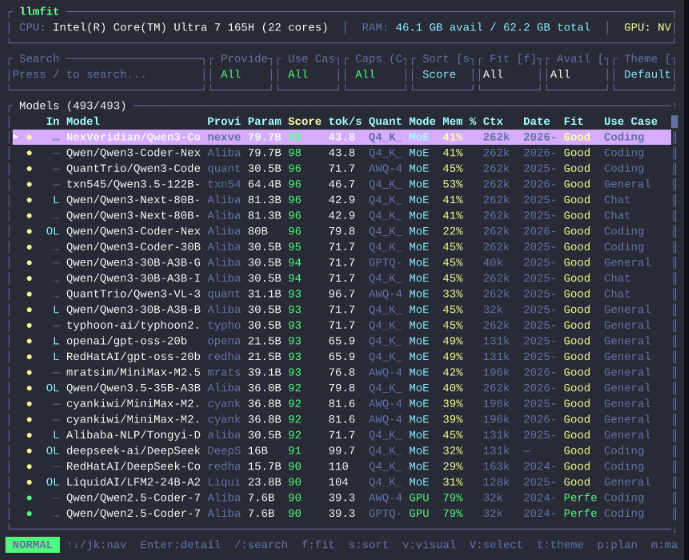

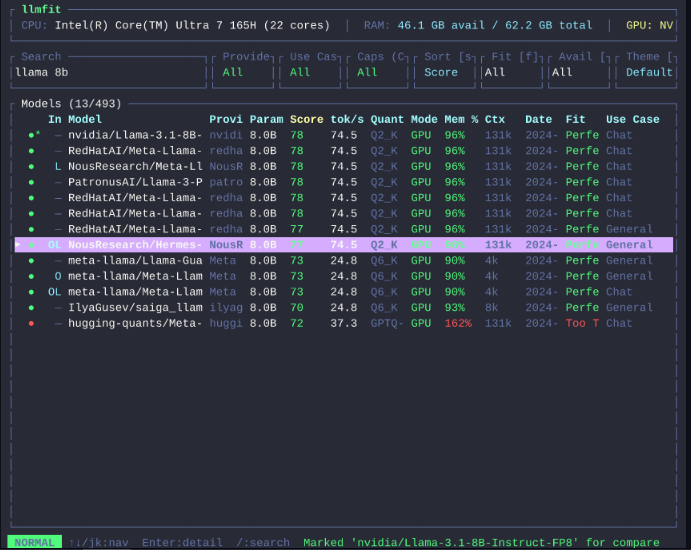

Que fait exactement llmfit ?

- Analyse les spécifications de votre appareil (RAM, CPU, GPU)

- Teste les performances des différents modèles

- Les évalue selon la qualité, la vitesse, l’adéquation et le contexte

- Vous recommande les modèles qui fonctionneront réellement sur votre appareil

- Vous donne les meilleurs paramètres d’exécution possibles

- Tout cela se fait avec une seule commande dans le terminal

De cette façon, vous évitez de télécharger des modèles volumineux qui ne conviennent pas à votre appareil et vous gagnez beaucoup de temps et d’espace de stockage.

À qui s’adresse llmfit ?

- Les développeurs qui travaillent avec des modèles locaux

- Les chercheurs et étudiants dans le domaine de l’intelligence artificielle

- Les passionnés qui aiment exécuter des LLM sur leurs appareils personnels

- Toute personne qui veut éviter les expériences ratées et la perte de temps

Conclusion

Avant de commencer à télécharger un modèle d’IA LLM, assurez-vous d’abord qu’il fonctionnera réellement sur votre appareil.

L’outil llmfit rend ce processus rapide, intelligent et fiable.

Si vous êtes un passionné d’exécution de modèles localement, cet outil deviendra l’un des outils essentiels de votre boîte à outils.

Lien du projet et guide d’installation sur GitHub :

llmfit