مقدمة

أصبح الكثير من المستخدمين يرغبون في تجربة نماذج الذكاء الاصطناعي LLM محليًا (مثل Llama، Gemma، Mistral، أو Qwen)، لكن المشكلة الشائعة دائمًا هي نفسها:

"هل سيعمل هذا النموذج على جهازي؟"

"هل الـ RAM يكفي؟"

"هل كرت الشاشة سيحتمل؟"

غالباً ما يقومون بتحميل النموذج (أحيانًا عدة جيجابايت)، ثم يكتشفون بعد ساعات أنه لا يعمل أو يعمل ببطء شديد… فيضيع الوقت والجهد سدى.

الحل البسيط والذكي لهذه المشكلة هو أداة llmfit.

في هذا المقال سأشرح لك بسرعة :

- ما هي أداة llmfit وكيف تعمل

- ما هي المميزات التي تقدمها

- لماذا هي مفيدة جدًا للمطورين ومحبي تشغيل النماذج محليًا

ما هي أداة llmfit؟

llmfit هي أداة مفتوحة المصدر مصممة خصيصًا لمساعدتك على فحص توافق نماذج الذكاء الاصطناعي LLM مع جهازك قبل تحميلها.

بدلاً من التخمين أو التجربة والخطأ، تقوم llmfit بفحص جهازك بشكل ذكي وتعطيك تقريرًا واضحًا ومباشرًا.

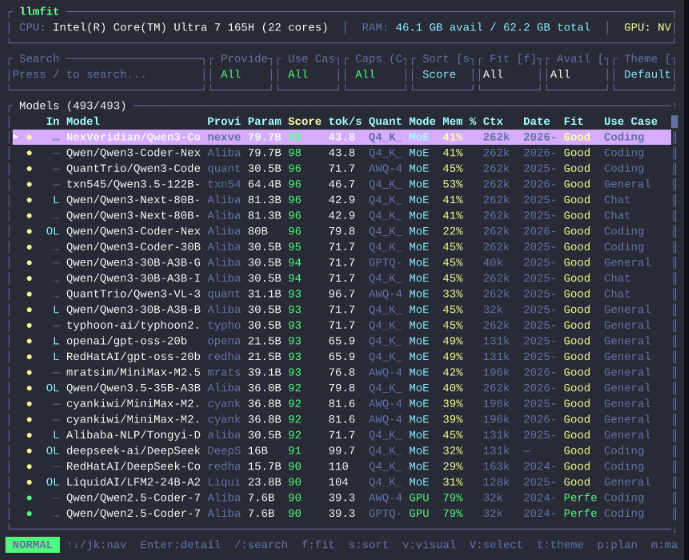

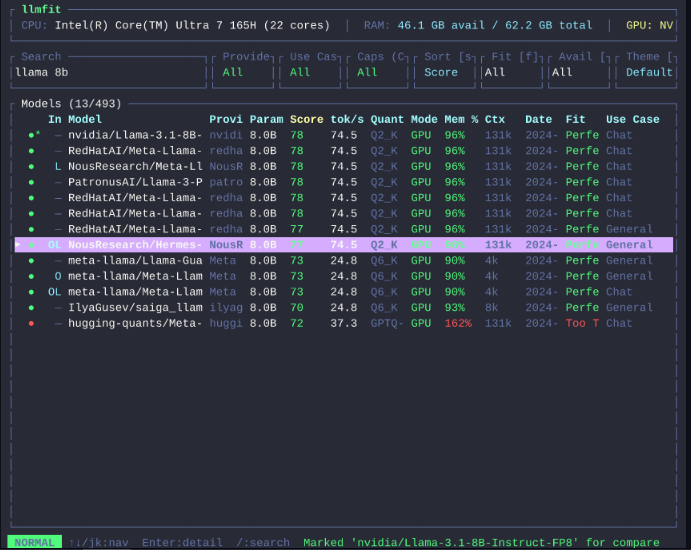

ماذا تفعل أداة llmfit بالضبط؟

- تفحص مواصفات جهازك (RAM، CPU، GPU)

- تختبر أداء النماذج المختلفة

- تقيمها حسب الجودة، السرعة، الملاءمة، والسياق

- تقترح لك النماذج التي ستعمل فعليًا على جهازك

- تعطيك أفضل إعدادات تشغيل ممكنة

- كل ذلك يتم بأمر واحد فقط من الطرفية

بهذه الطريقة تتجنب تحميل نماذج كبيرة لا تناسب جهازك، وتوفر وقتًا ومساحة تخزين كبيرة.

لمن هي أداة llmfit؟

- المطورون الذين يعملون على نماذج محلية

- الباحثون والطلاب في مجال الذكاء الاصطناعي

- محبي تشغيل LLM على أجهزتهم الشخصية

- أي شخص يريد تجنب تجارب فاشلة وإهدار الوقت

الخاتمة

قبل أن تبدأ في تحميل أي نموذج ذكاء اصطناعي LLM، تأكد أولاً من أنه سيعمل على جهازك.

أداة llmfit تجعل هذه العملية سريعة، ذكية، وموثوقة.

إذا كنت من عشاق تشغيل النماذج محليًا، فهذه الأداة ستكون من الأدوات الأساسية في مجموعتك.

رابط المشروع و طرييقة تتبيث على GitHub:

llmfit